L'IA a Toujours Besoin d'Aide pour le Débogage, Malgré les Avancées

L'IA fait des vagues dans le monde de la technologie, influençant même la façon dont nous écrivons le code. Des géants comme Google et Meta intègrent déjà l'IA dans leurs processus de développement de logiciels. Le PDG de Google, Sundar Pichai, a mentionné que 25 % de leur nouveau code est désormais généré par l'IA. Meta, dirigé par Mark Zuckerberg, a également de grands projets pour les modèles de codage d'IA.

Cependant, une nouvelle étude de Microsoft Research révèle que même les modèles d'IA les plus avancés, y compris ceux d'OpenAI et d'Anthropic, ont encore du mal avec les tâches que les développeurs expérimentés gèrent facilement : le débogage. Cette recherche sert de doux rappel : l'IA n'est pas tout à fait prête à remplacer l'expertise humaine dans des domaines tels que le codage.

L'Étude de Microsoft Research

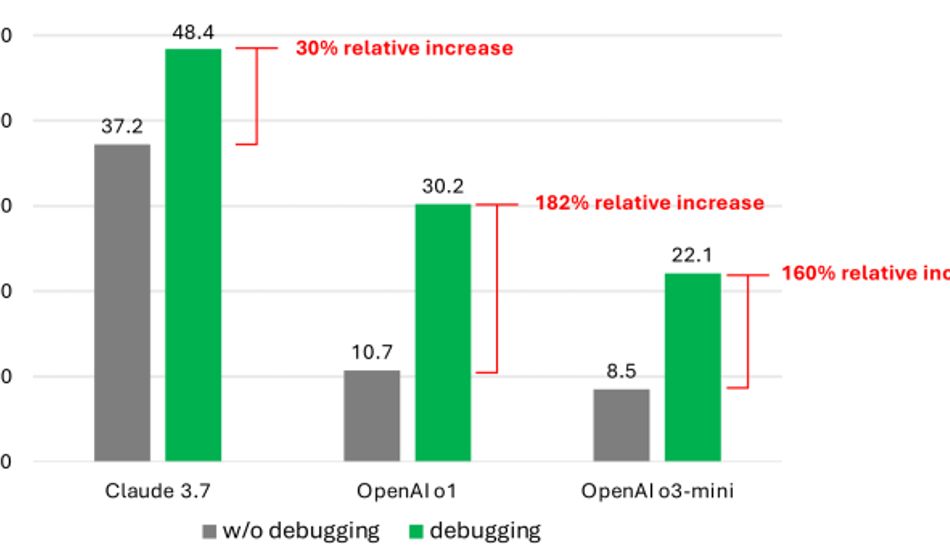

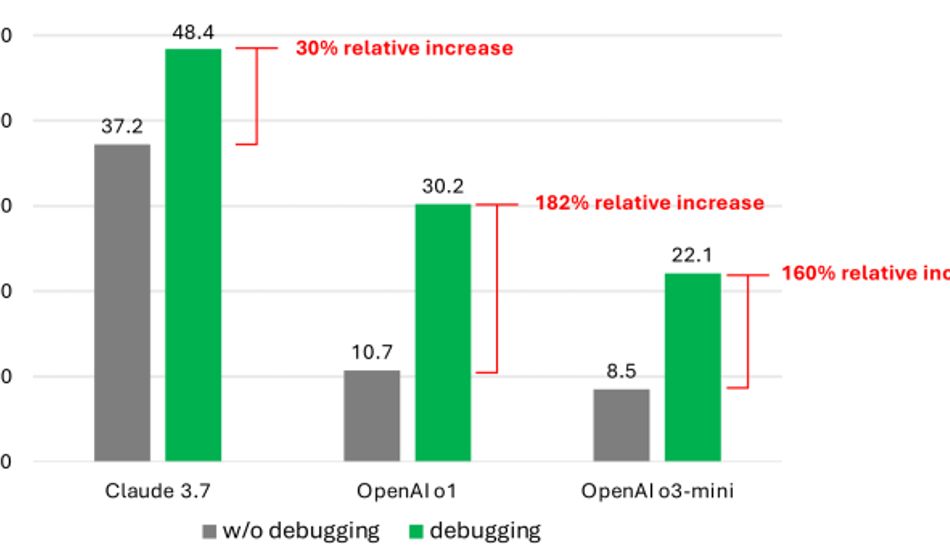

L'étude de Microsoft a mis à l'épreuve plusieurs modèles d'IA à l'aide d'un benchmark de débogage appelé SWE-bench Lite. Les modèles, agissant en tant qu'"agents basés sur une seule invite", avaient accès à des outils de débogage, notamment un débogueur Python. Malgré cela, ils n'ont souvent pas réussi à résoudre les bogues logiciels avec succès. Claude 3.7 Sonnet d'Anthropic a obtenu le meilleur taux de réussite moyen à 48,4 %, suivi des modèles d'OpenAI.

L'étude met en évidence les limites des modèles d'IA actuels dans le traitement des tâches de débogage complexes. L'un des problèmes est leur difficulté à utiliser efficacement les outils de débogage et à comprendre leur pertinence pour différents problèmes. Cependant, le défi le plus important semble être la pénurie de données. Les co-auteurs estiment que les modèles manquent de données d'entraînement suffisantes qui représentent les « processus de prise de décision séquentiels », essentiellement les stratégies de débogage humaines.

Bien que ces résultats ne soient pas totalement surprenants, ils mettent en lumière un domaine critique où l'IA doit s'améliorer. Des études antérieures ont montré que le code généré par l'IA peut introduire des vulnérabilités de sécurité et des erreurs en raison de faiblesses dans la compréhension de la logique de programmation. Cette recherche renforce l'idée que les outils de codage basés sur l'IA doivent être utilisés avec prudence.

Malgré ces défis, il est indéniable que l'IA a le potentiel d'aider les développeurs. Des leaders technologiques comme Bill Gates et le PDG de Replit, Amjad Masad, pensent que la programmation en tant que profession est là pour rester. La clé est de trouver un équilibre entre l'exploitation des capacités de l'IA et la confiance dans l'expertise humaine pour garantir la qualité et la sécurité du code.

1 Image de Débogage IA:

Source: TechCrunch